Florence-2 es un modelo de visión-lenguaje ligero y de código abierto presentado por Microsoft bajo la licencia MIT. Este modelo destaca por sus capacidades de zero-shot y ajuste fino en tareas como la creación de subtítulos, detección de objetos, grounding y segmentación. A pesar de su tamaño reducido, Florence-2 logra resultados comparables a modelos mucho más grandes, como Kosmos-2, gracias a su arquitectura eficiente y el uso del extenso dataset FLD-5B.

Representación unificada

Las tareas de visión varían en términos de jerarquía espacial y granularidad semántica. Por ejemplo, la segmentación de instancias proporciona información detallada sobre la ubicación de objetos dentro de una imagen, pero carece de información semántica. En contraste, la creación de subtítulos de imágenes permite una comprensión más profunda de las relaciones entre objetos, aunque sin hacer referencia a sus ubicaciones exactas.

Los autores de Florence-2 decidieron que, en lugar de entrenar una serie de modelos separados para tareas individuales, unificarían su representación y entrenarían un único modelo capaz de ejecutar más de 10 tareas diferentes. Sin embargo, esto requería un nuevo dataset.

Construcción de un dataset integral

Actualmente, no existen datasets grandes y unificados disponibles. Los datasets a gran escala existentes cubren tareas limitadas para imágenes individuales. SA-1B, el dataset utilizado para entrenar Segment Anything (SAM), solo contiene máscaras. COCO, aunque soporta una gama más amplia de tareas, es relativamente pequeño.

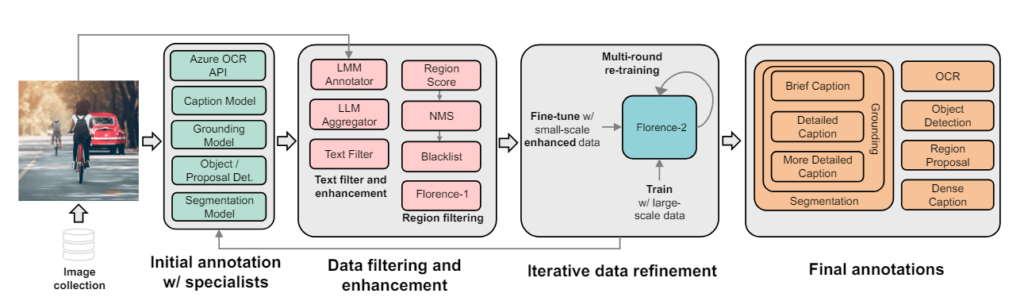

El etiquetado manual es costoso, por lo que para construir un dataset unificado, los autores decidieron automatizar el proceso utilizando modelos especializados existentes. Esto llevó a la creación de FLD-5B, un dataset que contiene 126 millones de imágenes y 5.4 mil millones de anotaciones, incluyendo cuadros, máscaras y una variedad de subtítulos a diferentes niveles de granularidad. Cabe destacar que el dataset no contiene imágenes nuevas; todas las imágenes pertenecen originalmente a otros datasets de visión por computadora.

FLD-5B aún no está disponible públicamente, pero los autores anunciaron su próximo lanzamiento durante CVPR 2024.

Arquitectura del modelo

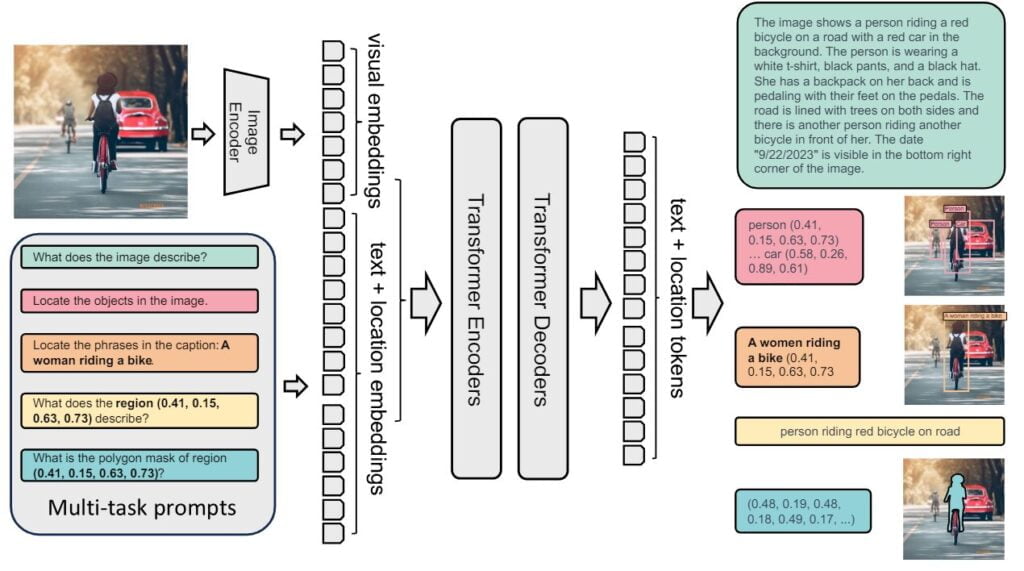

Florence-2 toma imágenes y prompts de tareas como entrada, generando los resultados deseados en formato de texto. Utiliza un codificador de visión DaViT para convertir las imágenes en embeddings de tokens visuales. Estos se concatenan con embeddings de texto generados por BERT y se procesan mediante un codificador-decodificador multimodal basado en transformers para generar la respuesta.

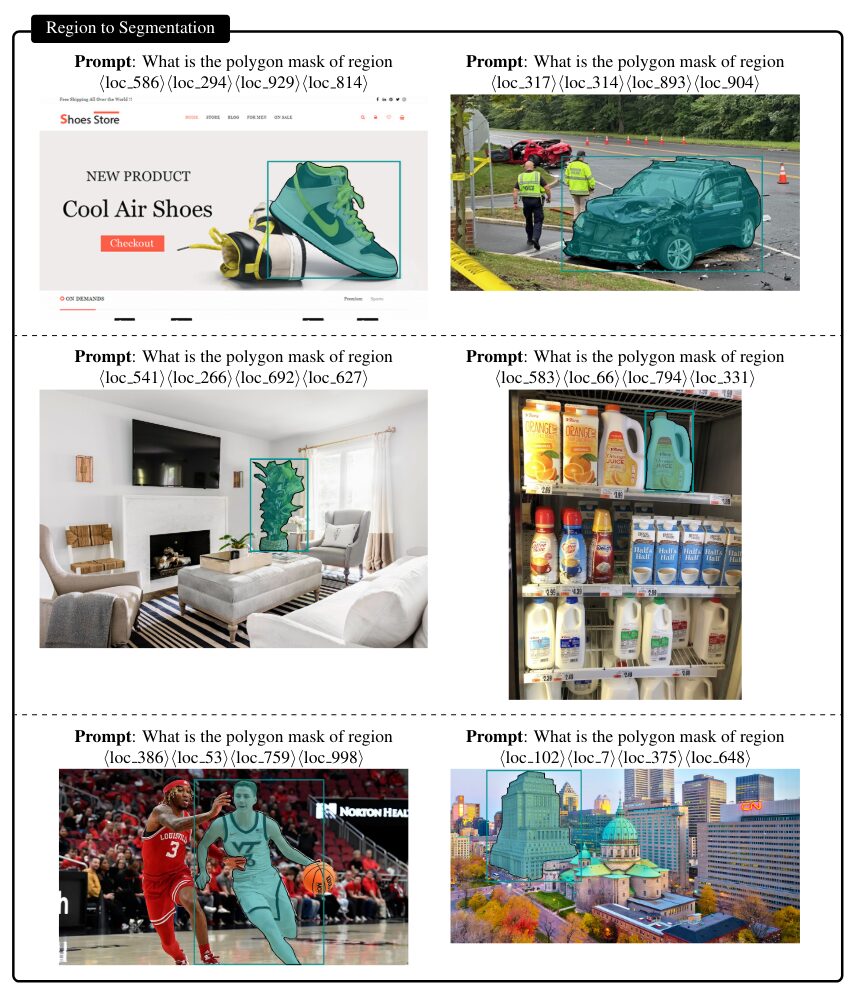

Para tareas específicas de regiones, se añaden tokens de ubicación que representan coordenadas cuantizadas al vocabulario del tokenizador.

Representación de cajas (x0, y0, x1, y1): Los tokens de ubicación corresponden a las coordenadas de la caja, específicamente las esquinas superior izquierda e inferior derecha.

Representación de polígonos (x0, y0, …, xn, yn): Los tokens de ubicación representan los vértices del polígono en orden horario.

Capacidades

- Florence-2 es más pequeño y más preciso que sus predecesores. La serie Florence-2 consta de dos modelos: Florence-2-base y Florence-2-large, con 0.23 mil millones y 0.77 mil millones de parámetros, respectivamente. Este tamaño permite su despliegue incluso en dispositivos móviles.

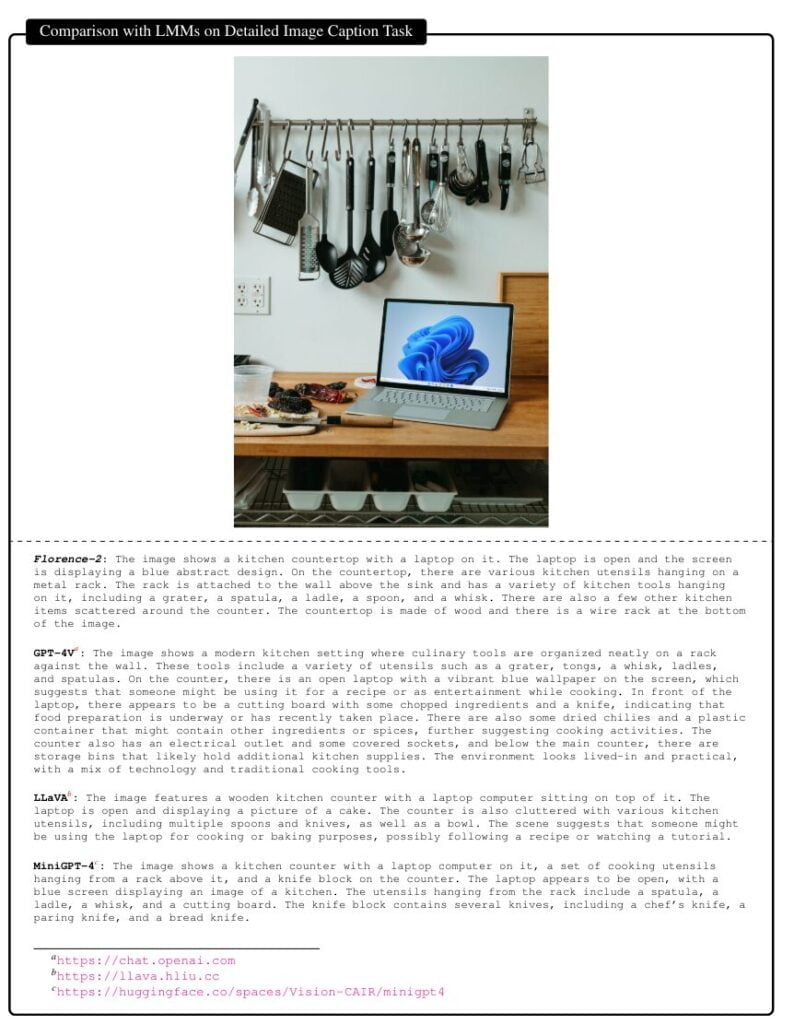

- A pesar de su tamaño reducido, Florence-2 logra mejores resultados zero-shot que Kosmos-2 en todos los benchmarks, aunque Kosmos-2 cuenta con 1.6 mil millones de parámetros.

Comparaciones y resultados

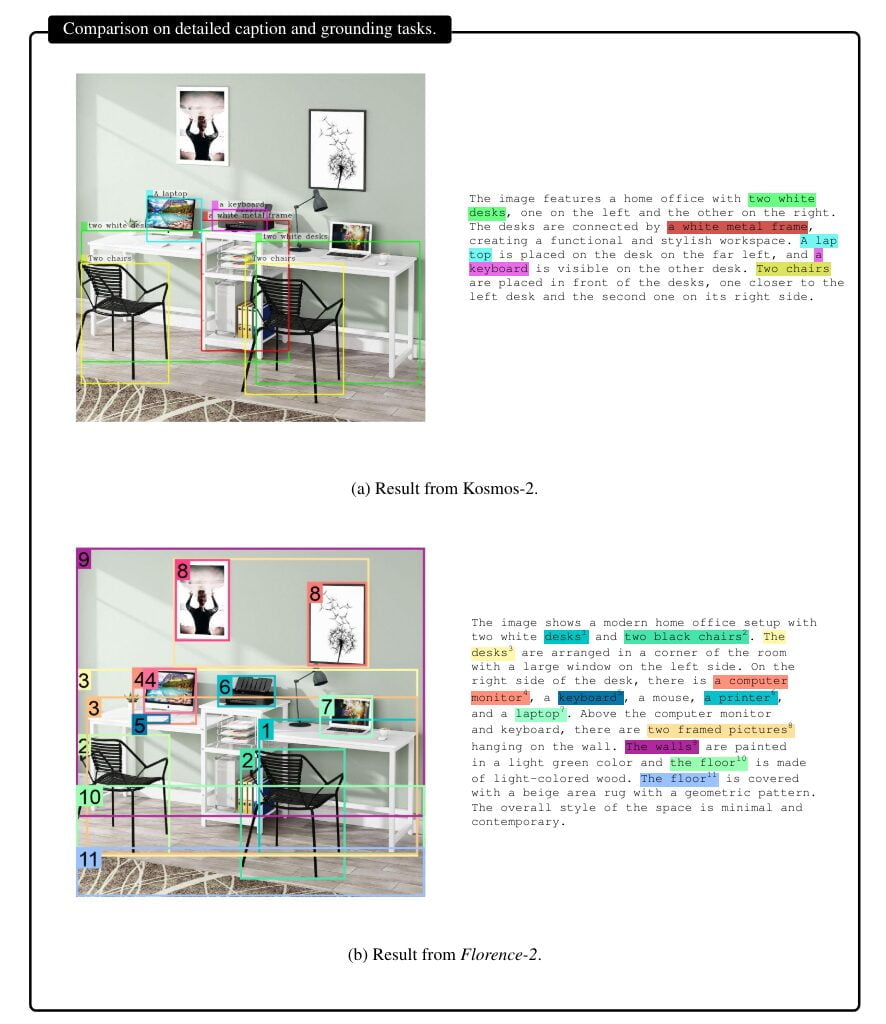

En comparaciones directas con otros modelos, Florence-2 demuestra su superioridad tanto en tareas de zero-shot como en fine-tuning. Incluso en comparación con modelos significativamente más grandes, como Kosmos-2, Florence-2 mantiene una ventaja en precisión y eficiencia. A continuación, se presentan algunos ejemplos de los resultados obtenidos por Florence-2 en diversas tareas de visión:

- Visual Grounding: Florence-2 puede identificar y localizar objetos específicos dentro de una imagen con gran precisión, como se muestra en la Figura 6.

- Reconocimiento de texto en regiones específicas: En tareas de OCR (reconocimiento óptico de caracteres) en regiones específicas, Florence-2 demuestra una alta capacidad para identificar y transcribir texto, como se muestra en la Figura 7.

- Detección de objetos de vocabulario abierto: Florence-2 puede detectar una amplia variedad de objetos, incluso aquellos no presentes en su entrenamiento inicial, destacándose en la detección de vocabulario abierto, como se observa en la Figura 8.

Implicaciones y aplicaciones

El desarrollo de Florence-2 y su capacidad para manejar múltiples tareas de visión con una sola arquitectura representa un avance significativo en el campo de la visión por computadora. Su implementación en dispositivos móviles y otros dispositivos con recursos limitados abre nuevas posibilidades para aplicaciones prácticas en el mundo real. Algunas de las aplicaciones potenciales incluyen:

- Dispositivos móviles: Florence-2 puede integrarse en aplicaciones móviles para mejorar las capacidades de fotografía, reconocimiento de objetos y accesibilidad.

- Sistemas de seguridad: La precisión en la detección y el reconocimiento de objetos hace que Florence-2 sea ideal para sistemas de vigilancia y seguridad.

- Asistentes virtuales: La integración de Florence-2 en asistentes virtuales puede mejorar la interacción usuario-máquina, permitiendo una comprensión más profunda y precisa de las instrucciones visuales.

A pesar de los avances logrados con Florence-2, existen desafíos pendientes que deben abordarse en futuras investigaciones. Uno de los principales desafíos es la creación y el acceso a datasets unificados y extensivos como FLD-5B. Además, la mejora continua de la eficiencia y la precisión del modelo, especialmente en tareas complejas y en tiempo real, es un área clave para futuras investigaciones.

Florence-2 representa un avance significativo en los modelos de visión-lenguaje al combinar una arquitectura ligera con capacidades robustas, haciéndolo altamente accesible y versátil. Su enfoque de representación unificada, apoyado por el extenso dataset FLD-5B, le permite sobresalir en múltiples tareas de visión sin la necesidad de modelos separados. Esta eficiencia convierte a Florence-2 en un fuerte competidor para aplicaciones del mundo real, especialmente en dispositivos con recursos limitados.